[도서 리뷰] AI를 움직이는 수학 이야기 - 사례로 시작해 AI의 블랙박스를 여는 수학책

- 수학 개념을 먼저 쌓기보다, 실제 AI 사례에서 출발해 필요한 수학으로 자연스럽게 연결합니다.

- AI를 공부하고 싶은데 수학에서 멀어진 개발자에게 진입 장벽이 적절합니다.

- 설명이 매우 자세한 편이라(476쪽) 호흡을 길게 잡고 읽는 걸 권합니다.

"한빛미디어 서평단 <나는리뷰어다> 활동을 위해서 책을 협찬 받아 작성된 서평입니다."AI를 움직이는 수학 이야기

TL;DR: 수학 개념을 먼저 설명하는 게 아니라, 실제 AI 사례(추천 시스템, 이미지 분류)에서 출발해 필요한 수학으로 자연스럽게 유도합니다. AI를 공부하고 싶은데 수학에서 멀어진 개발자에게 진입 장벽이 적절한 AI 관련 수학 책입니다.

책 소개

- 제목: AI를 움직이는 수학 이야기

- 출판사: 한빛미디어

- 저자: 후루시마 도오루

후루시마 도오루는 주식회사 cross-X 대표이사로, 교토대학교 법학부 졸업 후 컨설팅/IT 기업을 거쳐 cross-X를 창업했습니다. 컨설팅 회사에서는 데이터·AI 전략 프로젝트를 총괄했고, IT 기업에서는 경영·사업 관리 및 상장/자금 조달 등 사업 운영 경험을 쌓았으며, 현재는 대기업 DX(디지털 전환) 자문과 DX 인재 육성을 지원하고 있습니다.

수학과의 거리

웹 개발을 하다 보면 수학과 점점 거리가 멀어집니다. 물론 특정 알고리즘을 구현할 때는 필요하지만, 실무에서 수학이 직접 등장하는 일은 드물죠. 그마저도 이미 수많은 알고리즘이 라이브러리로 구현되어 있으니 더더욱 파고들 일이 없습니다.

그래도 게임 개발에 꾸준히 관심이 있어서 중간중간 게임 개발 관련 수학 책들을 들여다보곤 했습니다. 그러다 AI 시대가 본격화되면서 수학책의 방향 자체가 달라졌습니다. 이제 수학책들은 인공지능에 포커싱해서 나오고 있더군요.

그 중에 이 책을 집어 든 건데, 읽다 보니 다른 수학책들과는 접근 방식이 꽤 다릅니다.

보통 수학책과 다른 점

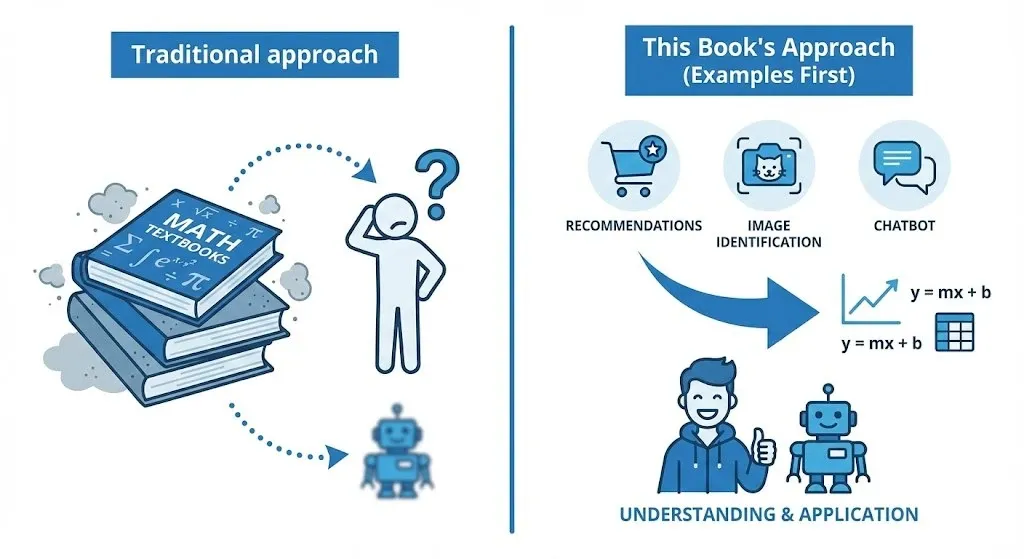

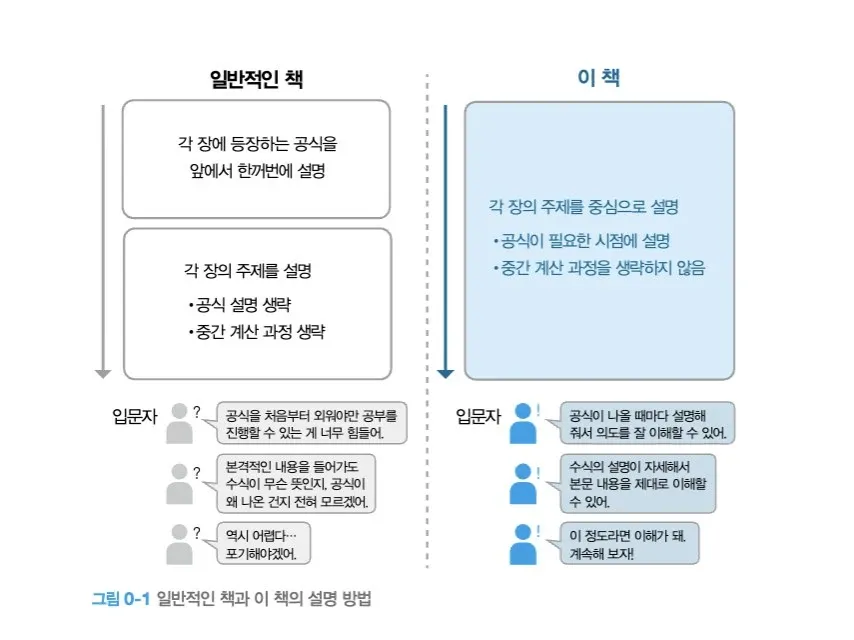

보통 수학책은 학교 교과서와 비슷한 순서를 따릅니다. 쉬운 개념에서 어려운 개념으로, 개념을 먼저 쌓고 그 위에 응용을 올리는 방식이죠.

이 책은 반대입니다. 실제로 사용되는 사례를 먼저 보여주고, 그 기능을 구현하는 데 필요한 수학으로 자연스럽게 연결합니다.

여기서 책이 의도하는 차이를 초반부터 그림으로 명확하게 보여주는데, 요지는 이렇습니다.

- 일반적인 구성: 공식을 먼저 쭉 훑거나(혹은 반대로 주제를 설명하면서도) 정작 “왜 여기서 이 공식이 필요한지”, “중간 계산이 어떻게 이어지는지”가 생략되기 쉬움

- 이 책의 구성: 각 장의 주제를 중심으로 설명하되, 공식이 필요한 순간에 공식이 등장하고 중간 계산 과정도 건너뛰지 않음

덕분에 입문자 입장에서는 “공식이 갑자기 튀어나와서 길을 잃는” 경험이 줄고, 따라가면서 이해할 여지가 생깁니다.

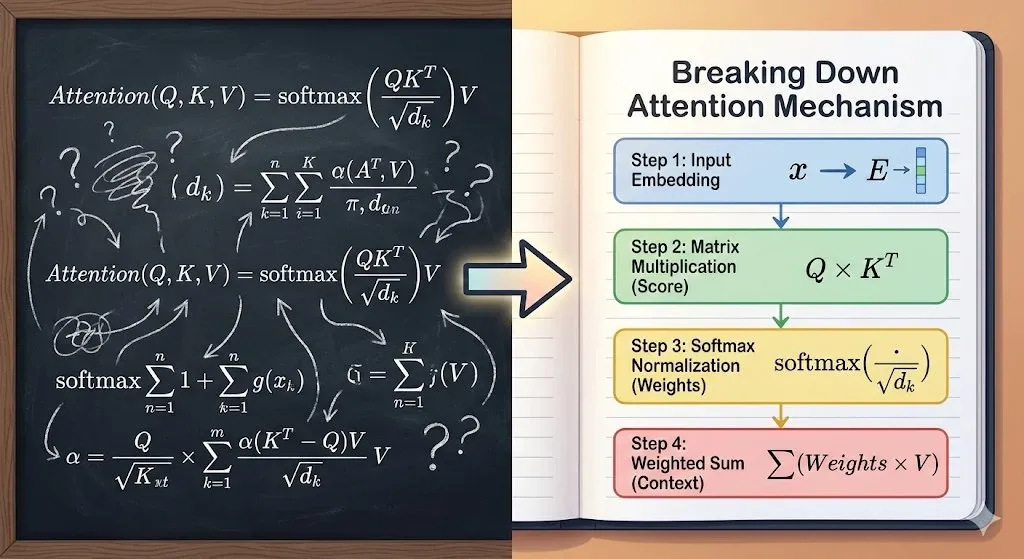

(이미지) 글 이해를 돕기 위해 직접 만든 개념도

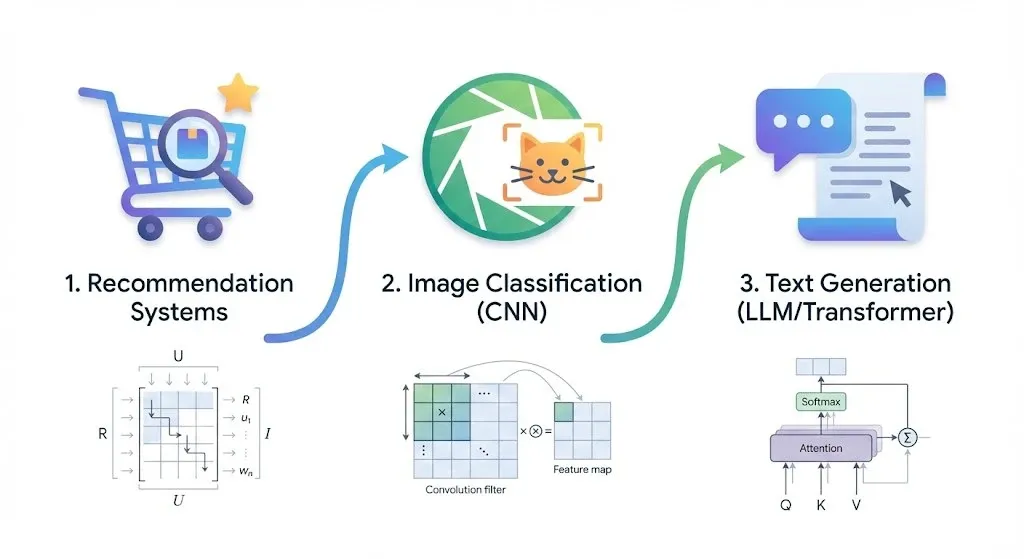

그리고 초반에는 정보 검색을 다룬 뒤, 이어서 추천 시스템 사례로 넘어갑니다.

추천 시스템으로 시작되는 여정

사용자 관점과 상품 관점에서 평가값을 예측하는 방식을 소개하고, 세렌디피티(serendipity) 관점의 추천까지 다룹니다. 그러면서 자연스럽게 손실 함수와 경사 하강법이 등장합니다.

머신러닝을 공부해보셨다면 익숙한 개념이죠. 그런데 이 책에서는 추천 시스템 구현 맥락에서 “왜 이 수학이 필요한가”가 먼저 납득된 상태에서 개념이 들어오기 때문에, 개념 자체가 훨씬 자연스럽게 받아들여졌습니다.

보법이 다르구나 싶었던 부분이 바로 여기입니다.

CNN — 생각보다 깊게 파고듭니다

추천 시스템 챕터를 넘기면 이미지 분류로 넘어갑니다. 합성곱 신경망(CNN)이 이미지를 어떻게 처리하는지 설명하는데, 여러 AI 책을 봤지만 이 정도 깊이로 다루는 책은 많지 않았습니다.

2012년 ImageNet 대회에서 압도적인 성능으로 우승한 모델 이야기도 나옵니다. 이름은 책에서 명확히 언급되지 않았지만, 딥러닝 역사에서 워낙 유명한 사건이라 읽으면서 바로 AlexNet 이야기구나 싶었습니다.

그 이후 CNN이 어떻게 발전해왔는지까지 다루는데, 이 부분이 다른 책들과 비교했을 때 확실히 깊이가 다릅니다.

LLM — 텍스트 생성의 수학

CNN 다음은 LLM으로 넘어갑니다. 텍스트를 어떻게 생성하는가, 그 출발점은 트랜스포머입니다. 구글의 "Attention is All You Need" 논문으로 시작된 아키텍처인데, 지금은 텍스트를 넘어 멀티모달, 음성, 비전 모델까지 폭넓게 쓰이고 있죠.

트랜스포머를 이해하려고 이전에 https://bbycroft.net/llm에서 구조를 하나하나 뜯어본 적이 있는데, 이 책도 그런 방식입니다.

페이지를 열면 공식들에 숨이 턱 막히는데, 막상 하나하나 곱씹어보면 이해가 됩니다. 단순히 "이렇게 동작한다"가 아니라 각 단계마다 "왜 이 계산이 필요한가"까지 짚어줘서, 읽고 나면 LLM을 그냥 블랙박스로 쓰는 게 아니라 내부에서 무슨 일이 벌어지는지 어느 정도 그림이 그려지는 느낌입니다.

그 대신 읽는 데 시간이 꽤 걸립니다. 총 6개 챕터 중 아직 4개밖에 못 읽었습니다. 뒷부분에서는 음성과 위치 측정에 사용되는 수학도 다룬다고 하는데, 이 부분은 완독 후 따로 추가할 예정입니다.

476쪽을 아끼지 않는 설명

챕터는 6개로 많지 않습니다. 그런데 실제 분량은 476쪽입니다. 그 분량 대부분이 수식 전개와 흐름 설명에 쓰입니다.

챕터 주제에 따라 수식을 단계적으로 전개하기도 하고, 개념의 흐름이 어떻게 이어지는지 풀어서 설명하기도 하는데, 공통점은 독자가 결국 이해할 수 있도록 페이지를 아끼지 않는다는 점입니다.

쉽지는 않습니다. 하지만 차근차근 읽어나가면 결국 이해가 됩니다. 식만 잔뜩 나열하는 게 아니라, 왜 이 식이 나오는지를 순서대로 짚어주기 때문에 포기하지 않고 따라갈 수 있더군요.

마치며

수학에서 멀어진 웹 개발자가 AI 동작 원리를 이해하고 싶을 때 진입 장벽이 낮은 책입니다. 사례 먼저, 수학 나중이라는 흐름 덕분에 "이걸 왜 배워야 하지?"라는 물음 없이 읽히더군요.

다만 그만큼 호흡이 긴 책이라, 시간을 넉넉하게 잡고 읽는 걸 권합니다.

Refs

- 한빛미디어 「AI를 움직이는 수학 이야기」: https://www.hanbit.co.kr/store/books/look.php?p_code=B2593246869

- AlexNet (Wikipedia): https://en.wikipedia.org/wiki/AlexNet

- Krizhevsky et al. (2012), ImageNet Classification with Deep Convolutional Neural Networks, NeurIPS

- Vaswani et al. (2017), Attention is All You Need, NeurIPS

- LLM Visualizer: https://bbycroft.net/llm